大数据时代,我们真的还有隐私吗?

生活在大数据时代下的我们,似乎正经历着《1984》所描绘的场景——无论我们说了什么、做了什么、想了什么,“老大哥”(大数据)都了如指掌。

最近,整个大数据行业如履薄冰:

- 最开始是三家大数据公司被查。

- 9月11日夜里,公信宝也传出消息,公司门口被贴了封条。

- 9月12日上午,又传出天翼征信被调查的消息。

天翼征信官网显示,该公司成立于2014年,是中国首家运营商旗下征信机构,属于电信控股的子公司。

“连国企都开始被调查了,可见数据行业的整顿力度之大。”

多位数据行业从业者认为,大数据行业自诞生以来最大的行业地震到来。

引言

近期,网安部门联合多个部门,针对大数据行业的乱象展开了整治行动,以上描述便是本次大数据行业治理行动的缩影。

网络和大数据的发展带来了极大的便利和社会效率的提升,但与此同时,社会管理和数据伦理规范的滞后性导致了数据风险一定程度上的失控。

01

维克托·迈尔·舍恩伯的《大数据时代》揭示了在大数据时代的三大风险:

- 无所不在的“第三只眼”

- 为“将要”犯罪受到惩罚

- 数据独裁

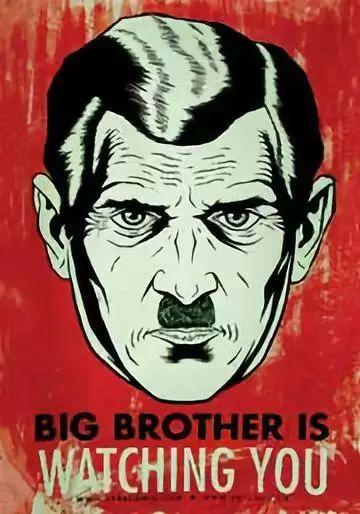

老大哥在看着你

英国作家乔治·奥威尔在早些年出版的小说《1984》中,描述了一个极权社会里面的极权政权“老大哥”。

他为了维持和巩固其凌驾于社会之上的绝对权力,便对社会的每一个成员进行全方位监控:不论是你说了什么、做了什么,“老大哥”都会知道,甚至包括你在想什么也都能了如指掌。

大数据时代下,这一社会寓言似乎正在成为现实:

- 淘宝监视着我们的购物习惯

- 百度监视着我们的网页浏览习惯

- 抖音编织出一个个看似美丽的“信息茧房”

来过必留痕迹,互联网的发展,使得监视变得更容易、成本更低廉且更有用处。

微博上使用手机监控、广告推送进行搜索能够轻易搜出许多的案例。

进行大数据分析的人可以轻而易举地看到大数据地价值潜力,这极大刺激着他们进一步采集、存储、循环利用我们个人数据的野心。

你的数据塑造了你,同时“老大哥”们也能够利用数据影响着你。

2018年3月,《纽约时报》等媒体揭露称一家服务特朗普竞选团队的数据分析公司Cambridge Analytica获得了Facebook数千万用户的数据,并进行违规滥用。

Cambridge Analytica自称主要为政界人士和企业客户提供消费者研究、定向广告和其他与数据有关的服务。

该公司吹嘘说,它可以开发消费者和选民的心理特征,然后用这个“秘密武器”来影响消费者和选民的意愿,这比传统广告更加有效。

该公司最著名的工作是曾协助美国总统特朗普的2016年总统竞选活动。

除了与特朗普团队的合作之外,Cambridge Analytica还参与了美国和英国的几十场政治活动,包括英国退欧公投,以及参议员泰德·科鲁兹2016年的初选。

此外,大数据时代下,数据的交叉比对使得匿名化近乎毫无意义,足够大量的数据维度对比能够简单地定位到真实个人,同时Ta的任何隐私将无所遁形。

预测与惩罚,不是因为“所做”,而是因为“将做”

电影《少数派报告》中,描述了男主角逮捕一位即将在当天犯下杀人罪行的“罪犯”。

在这个社会,人们因为将做而受到惩罚,而不是因为已经实施犯罪。

但是《少数派报告》中这个令人不安的社会,正是不受限制的大数据分析可能导致的:罪责的判定是基于个人未来行为的预测。

宾夕法尼亚大学的理查德·伯克教授建立了一个大数据模型,他声称这个模型可以预测一个判缓刑的人一旦释放是否会再次犯罪。

伯克说这一模型对未来预测的准确性可以达到75%,听起来不错的数字。但是,这意味着,每四个人里面可能就有一个人因为模型的失误而错判。

此外,主要的问题并不是模型的准确性,而是我们在人们真正犯罪之前对他进行惩罚,否定了人的自由权利。

我们永远不会知道他是否真的会犯罪,而我们的预测也永远不会得到证实。

数据独裁

大数据大大威胁到我们的隐私和自由,这都是大数据带来的新威胁,与此同时,过于依赖数据的趋势也在加剧。

大数据诱使我们盲目信任数据的力量和潜能,而忽略了它的局限性。如果对不可量化的实物进行量化,我们就会失去全面了解它的机会。

用标准化测试来检验学生的表现和评定对老师、学校的奖惩是不合理的。

考试是否能全面展示一个学生的能力?是否能有效检测教学质量?

这些都饱受争议,但是数据本身不会显示这些问题的存在。

02

2017年6月1日,《网络安全法》开始实施。但是,由于数据生意的巨大利益,仍有为数不少的数据公司游走在法律边缘。

大数据行业,其实存在很多所谓的“黑产数据的搬运工”公司。

简历数据爬取、网格照片缓存、用户信息盗取,拿到这些数据后,自然可以清洗包装,之后供给营销甚至诈骗之用,卖个好价钱。

目前,整个行业近乎停摆,大数据行业正在经历着推翻重生的历程。

03

当世界开始迈向大数据时代时,社会也将经历类似的地壳运动,生产和信息交流方式的变革必然会引发社会管理规范的变革。

首先,对于个人隐私保护的责任需要从民众转移到数据使用者。

当前,数据的使用依赖于事前的告知与授权。大数据时代,数据二次利用的不确定性导致事前告知的个人许可模式意义不大。

因此应该让数据使用者承担数据保护责任,使其为敷衍了事的评测和不达标准的保护措施承担法律责任。

第二点,大数据时代下,很重要的一点是保障人们选择的自由意志(个人可以并应该为他们的行为而非倾向负责)。

公开分析数据与算法系统、第三方公证的可靠算法和个人对其预测结果进行反驳的权利,有助于保护个人免受单纯依赖大数据预测的危害。

这些危害包括诸如对未进行的行为承担责任、基于算法预测的雇佣与解雇行为,以及按揭或信用卡的评估结果等。

由于对大数据运作的理解依赖于专业的算法知识,大数据预测、算法和数据库有变成黑盒子(不透明、不可解释、不可追踪)的风险。

因此需要大数据算法工程师来担任大数据分析和预测的评估专家。

他们需要监控数据源的挑选、分析和预测工具的选取,甚至包括运算法则和模型,以及计算结果的解读是否正确合理(类比当前的财务审计)。

另外,保护极具竞争性的大数据市场,防止数据大亨的崛起与垄断,是避免数据独裁的重要手段。

结语

大数据时代并不是一个充斥着算法和机器的冰冷世界,人类的作用依然无法完全替代。

我们要正确认识大数据的风险和局限性,更好的方法和答案或许在未来的将来。

作者:Ray,公众号:Ray的数据分析自习室

本文由 @Ray 原创发布于人人都是产品经理,未经作者许可,禁止转载。

题图来自Unsplash,基于CC0协议

作者暂无likerid, 赞赏暂由本网站代持,当作者有likerid后会全部转账给作者(我们会尽力而为)。Tips: Until now, everytime you want to store your article, we will help you store it in Filecoin network. In the future, you can store it in Filecoin network using your own filecoin.

Support author:

Author's Filecoin address:

Or you can use Likecoin to support author: